Tudo sobre ChatGPT

Tudo sobre OpenAI

A OpenAI anunciou nesta semana um novo recurso de segurança no ChatGPT: o “Contato de Confiança”. O sistema agora permite que adultos indiquem uma pessoa próxima (como amigo, familiar ou cuidador) para ser avisada caso a empresa identifique sinais graves de risco de automutilação ou suicídio durante as conversas com o chatbot.

Continua após a publicidade

A novidade chega em meio ao crescimento do uso do ChatGPT como uma espécie de terapeuta digital. Segundo informações divulgadas pela OpenAI à BBC, mais de um milhão dos cerca de 800 milhões de usuários semanais da plataforma relatam pensamentos suicidas em conversas com a inteligência artificial.

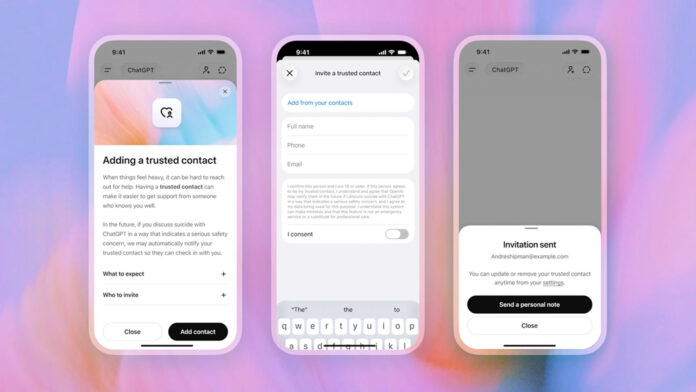

O novo recurso amplia mecanismos de segurança que antes eram voltados apenas a adolescentes em contas supervisionadas pelos pais. Agora, qualquer usuário maior de 18 anos poderá cadastrar um adulto como contato de emergência diretamente nas configurações do ChatGPT. Na Coreia do Sul, a idade mínima será de 19 anos.

O funcionamento do sistema inclui várias etapas:

- Primeiro, o contato indicado recebe um convite explicando sua função e precisa aceitar a solicitação em até uma semana. Caso isso não aconteça, o usuário poderá selecionar outra pessoa.

- Se os sistemas automatizados da OpenAI identificarem conversas relacionadas a automutilação ou suicídio consideradas potencialmente graves, o ChatGPT avisará o usuário de que o contato poderá ser notificado;

- O sistema também incentivará a pessoa a procurar ajuda diretamente e até sugerirá maneiras de iniciar a conversa.

A OpenAI afirma que o processo não será totalmente automático. Antes de qualquer alerta ser enviado, uma equipe humana especializada analisará a situação.

“Embora nenhum sistema seja perfeito e uma notificação para um Contato de Confiança nem sempre reflita exatamente o que alguém está vivenciando, cada notificação passa por uma revisão humana especializada antes de ser enviada, e nos esforçamos para revisar essas notificações de segurança em menos de uma hora”, informou a empresa em comunicado.

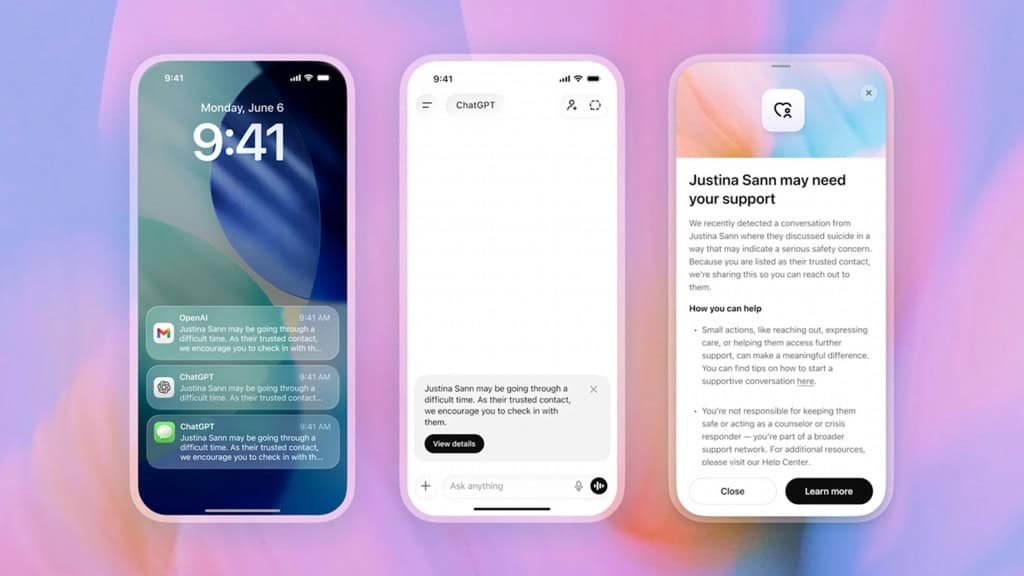

Se a equipe concluir que existe uma ameaça séria à segurança do usuário, o contato cadastrado poderá receber uma mensagem por e-mail, SMS ou notificação no aplicativo.

[Nome do usuário] pode estar passando por um momento difícil. Como seu Contato de Confiança, recomendamos que você entre em contato com ele.

Segundo a OpenAI, o alerta enviado será limitado para preservar a privacidade do usuário. O contato receberá apenas uma explicação geral de que houve uma conversa relacionada a risco de autolesão, sem acesso às transcrições do chat.

Novidade no ChatGPT teve apoio de profissionais de saúde

A empresa afirma que o recurso foi desenvolvido com apoio de especialistas em saúde mental, pesquisadores e organizações ligadas à prevenção do suicídio. Entre os colaboradores estão membros da Rede Global de Médicos da OpenAI e do Conselho de Especialistas em Bem-Estar e Inteligência Artificial.

“A ciência psicológica demonstra consistentemente que a conexão social é um poderoso fator de proteção, especialmente durante períodos de sofrimento emocional. Ajudar as pessoas a identificar antecipadamente uma pessoa de confiança, preservando ao mesmo tempo sua capacidade de escolha e autonomia, pode facilitar a busca por apoio presencial quando mais importa”, afirmou Arthur Evans, diretor executivo da Associação Americana de Psicologia.

Continua após a publicidade

A OpenAI também destacou que o recurso não substitui ajuda profissional, linhas de emergência ou acompanhamento psicológico presencial. Segundo a companhia, o objetivo é criar uma camada adicional de proteção em momentos de crise.

O anúncio acontece após uma série de críticas envolvendo o comportamento do ChatGPT em conversas relacionadas à saúde mental. No ano passado, a OpenAI foi alvo de um processo por homicídio culposo envolvendo o suicídio de um adolescente. A ação alegava que o chatbot teria discutido métodos de suicídio e ajudado o jovem a planejar sua morte. O Olhar Digital deu os detalhes aqui.

Além disso, uma investigação publicada pela BBC em 2025 apontou casos em que o ChatGPT teria fornecido orientações sobre automutilação. Desde então, a empresa afirma ter reforçado os mecanismos de segurança da plataforma.

Entre as medidas citadas pela OpenAI estão a recusa em fornecer instruções relacionadas a suicídio, o incentivo ao contato com serviços de emergência e o aprimoramento das respostas do sistema em situações de sofrimento emocional.

Vitoria Lopes Gomez

Vitoria Lopes Gomez é jornalista formada pela Universidade Estadual Paulista (UNESP) e redatora do Olhar Digital.