Tudo sobre Google

Tudo sobre Inteligência Artificial

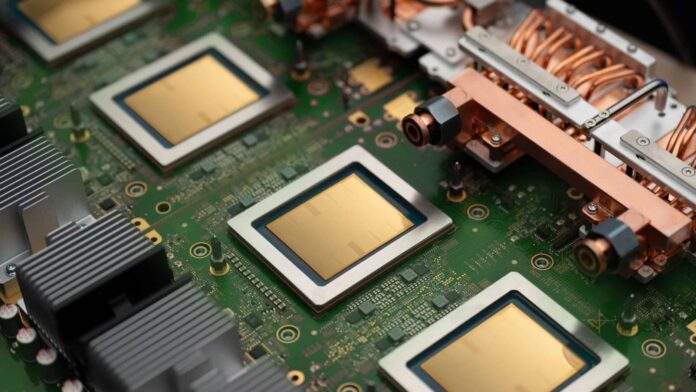

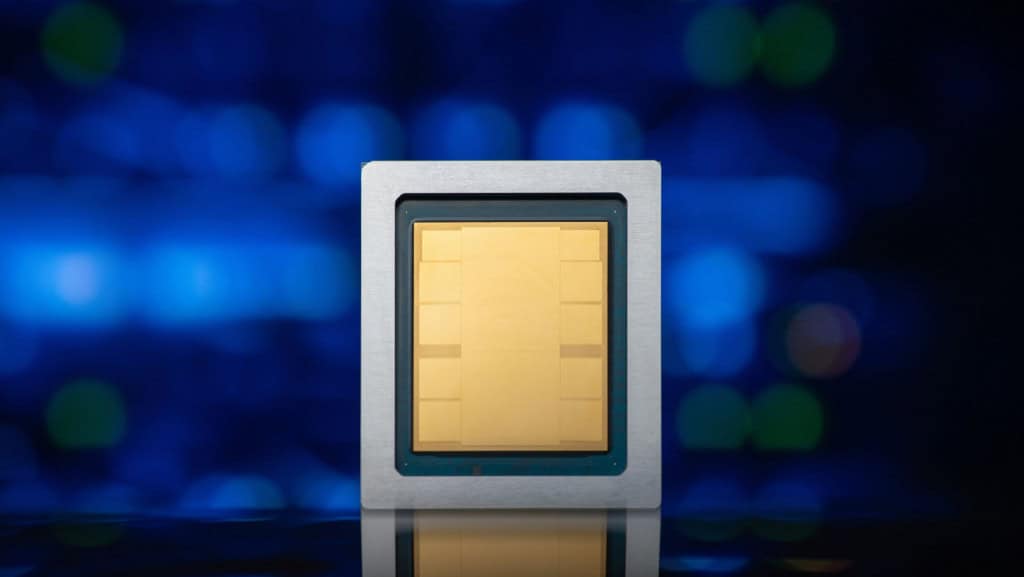

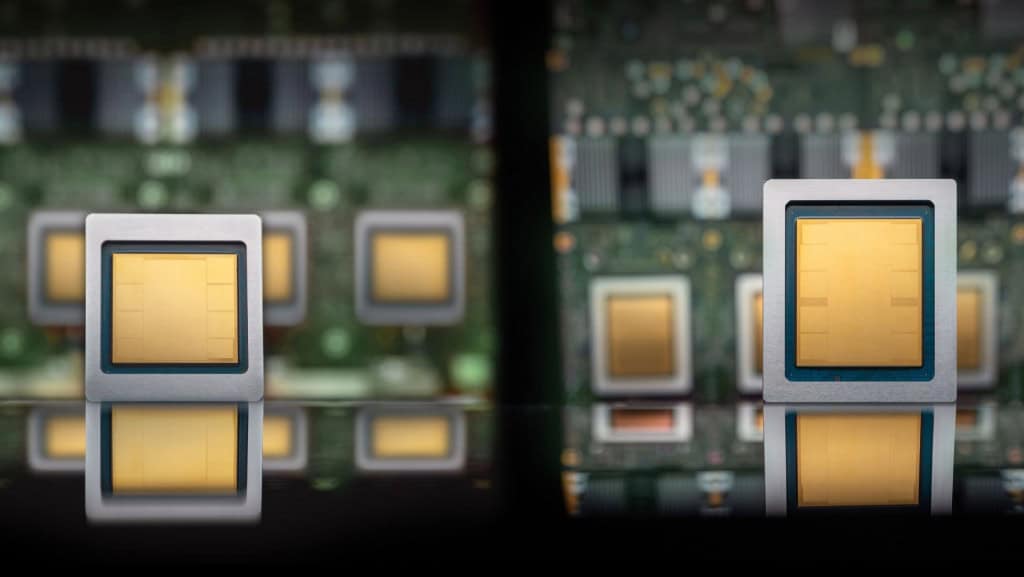

Nesta quarta-feira (22), um dos destaques do Google Cloud Next 2026 foi a apresentação da oitava geração de chips (processadores): peças de hardware projetadas para alimentar supercomputadores com inteligência artificial, desenvolvidos sob medida. Ao todo, dois chips foram divulgados: o TPU 8t e o TPU 8i.

Continua após a publicidade

O Google destaca que esses periféricos impulsionaram o funcionamento do Gemini e são úteis para treinar IA, criar novos agentes de IA, e auxiliar chatbots de IA a responderem o questionamento dos usuários com maior eficácia.

A companhia ainda destaca que as novas peças podem rodar inteligência artificial em grande escala, ou seja, atendendo a milhões de usuários, e até a consumir menos energia para funcionar.

A justificativa por trás do desenvolvimento dos novos processadores é a maior demanda de trabalho, ocasionada pelo número crescente de usuários que acessam a inteligência artificial. Com o novo poder de processamento, é possível executar fluxos de trabalho com muito mais etapas.

O resultado deste projeto é fruto de uma parceria com o departamento Google DeepMind, o laboratório da empresa focado em pesquisa com IA.

O que é o Google Cloud Next?

O Google Cloud Next é uma conferência anual na qual a empresa divulga novidades relacionadas à computação em nuvem, cibersegurança, inteligência artificial, novos produtos e muito mais.

A edição de 2026 ocorre entre os dias 22 e 24 de abril no Mandalay Bay Convention Center, Las Vegas (EUA). O evento é destinado a desenvolvedores, engenheiros de dados, profissionais de TI e jornalistas que cobrem tecnologia.

Conheça os novos processadores de IA do Google: TPU 8t e TPU 8i

Após a alta demanda de tarefas para os chatbots alimentados por inteligência artificial, as empresas de tecnologia (como o Google) desenvolveram algo mais “autônomo”: agentes de IA, softwares programados para executar tarefas de forma ‘autônoma’.

O Google justifica a criação dos novos processadores TPU 8t e TPU 8i como uma forma de criar agentes de IA que raciocinassem mais rápido para executar um maior fluxo de trabalho, com múltiplas etapas, e capazes de aprender com suas próprias ações em ciclos contínuos.

Nisso, a empresa comenta que ficou mais de uma década desenvolvendo os processadores e que produziu duas versões de chips para cada uma obter uma especialização diferente quanto ao ganho de eficiência e desempenho.

Ou seja, a IA ficou mais complexa com o passar dos anos e novos hardwares precisaram ser construídos. Sobre os chips do Google, um é especializado em treinar modelos ‘gigantes’ e o outro é indicado para rodar a IA no ‘mundo real’.

Essa divisão torna tudo mais barato e eficiente. Confira a diferença entre ambos abaixo.

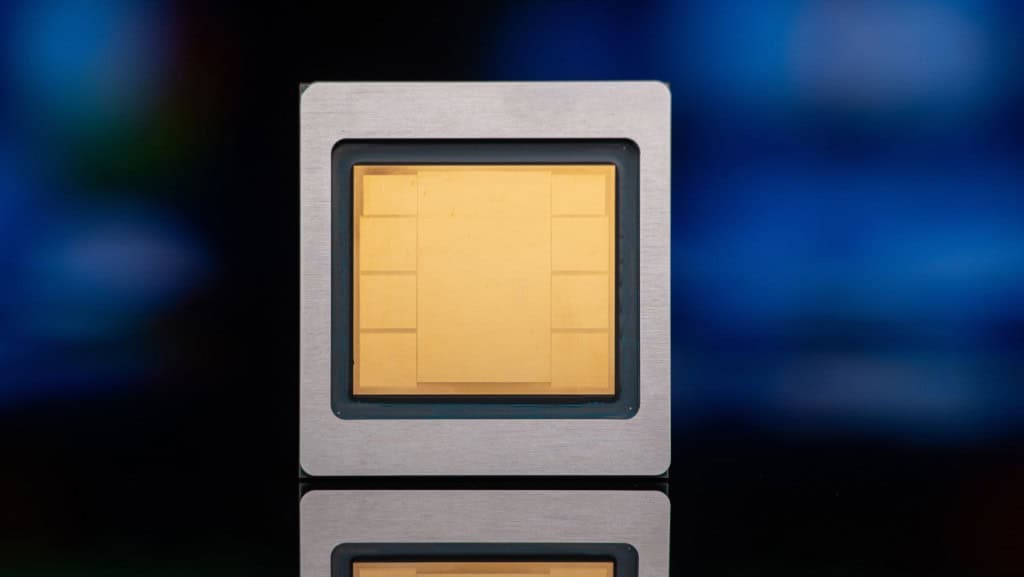

TPU 8t

O TPU 8t foi desenvolvido com foco no treinamento de sistemas de inteligência artificial em larga escala. Ele se destaca por ser ajustado para lidar com cargas de trabalho extremamente exigentes, que demandam alto desempenho computacional e comunicação eficiente entre diversos chips.

Continua após a publicidade

Sua finalidade é tornar mais rápido o avanço de modelos complexos, encurtando processos de treinamento que antes levavam meses para apenas algumas semanas. Para isso, conta com grande capacidade de processamento, elevada taxa de transferência de dados entre os componentes e acesso ágil a grandes volumes de informação, permitindo que estruturas amplas operem de maneira integrada.

Além disso, o TPU 8t foi pensado para funcionar em ambientes de grande escala, reunindo milhares de unidades que atuam como um único sistema coeso. Ele busca aproveitar ao máximo o tempo de execução, reduzindo interrupções e falhas que poderiam comprometer o progresso do treinamento.

Esse aspecto é crucial em projetos de IA de grande porte, onde qualquer perda de eficiência pode significar atrasos significativos. Assim, esse processador tem como prioridade oferecer desempenho elevado aliado à confiabilidade durante longos períodos de operação contínua.

Continua após a publicidade

Esse tipo de arquitetura opera em uma escala extremamente ampla. Um único cluster baseado no TPU 8t pode integrar até cerca de 9.600 chips atuando de forma coordenada, todos conectados a um sistema de memória compartilhada de altíssima capacidade.

Com isso, modelos de inteligência artificial muito grandes conseguem utilizar esse conjunto como se fosse um único supercomputador unificado. A interligação entre os chips também foi otimizada, garantindo taxas de comunicação mais rápidas em comparação com gerações anteriores.

Outro ponto importante é a capacidade de expansão. Mesmo quando o sistema cresce para dezenas de milhares ou até mesmo milhões de chips operando em conjunto, ele mantém um nível elevado de eficiência e desempenho.

Isso é viabilizado por uma combinação de redes especializadas e softwares de gerenciamento que organizam o tráfego de dados e coordenam as tarefas entre todos os componentes.

Continua após a publicidade

Além disso, essa infraestrutura foi projetada com foco em alta confiabilidade. Caso alguma parte do sistema apresente falhas, o processamento não precisa ser interrompido: o próprio sistema identifica automaticamente os problemas e se reorganiza para continuar funcionando.

Leia mais:

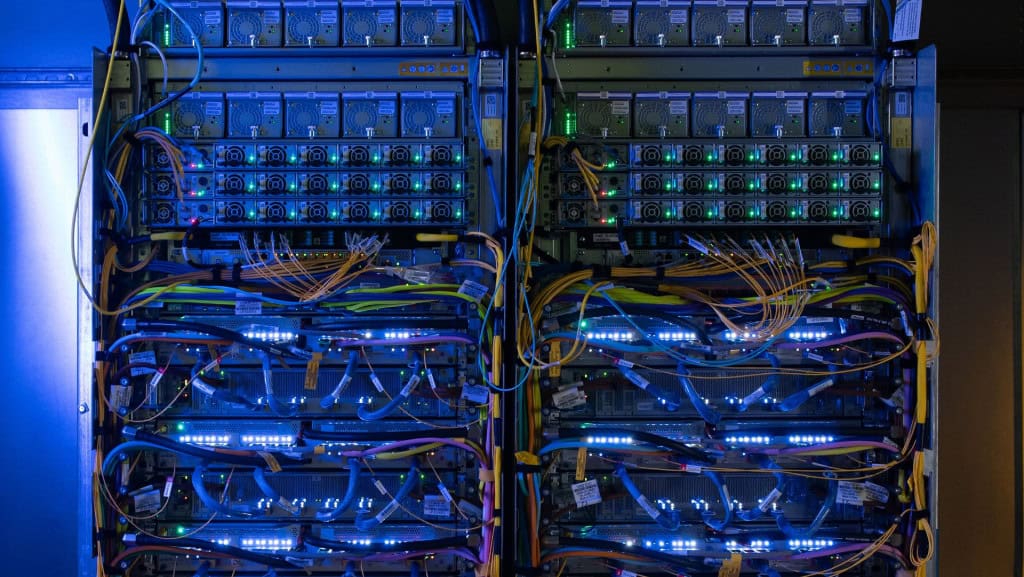

TPU 8i

O TPU 8i, em contraste, é voltado para a fase de inferência, isto é, quando os modelos de inteligência artificial já estão treinados e passam a ser utilizados no dia a dia. Sua otimização é direcionada para o processamento rápido de respostas, priorizando baixa latência e um uso eficiente dos recursos de memória.

Esse tipo de arquitetura é especialmente importante em aplicações que exigem interação imediata, muitas vezes envolvendo vários sistemas de IA atuando em conjunto e trocando dados em tempo real.

Continua após a publicidade

Para atender a esse cenário, o TPU 8i foi projetado para minimizar atrasos e manter o máximo de informações possível próximas do processador, reduzindo o tempo de acesso aos dados. Ele também aprimora a troca de informações entre diferentes componentes do sistema, algo essencial quando múltiplos modelos precisam colaborar em tarefas mais complexas.

Assim, seu principal objetivo é assegurar respostas rápidas, consistentes e eficientes, mesmo quando há uma grande quantidade de solicitações acontecendo simultaneamente.

O TPU 8i foi projetado para maximizar o aproveitamento dos processadores, reduzindo ao mínimo os períodos em que eles ficam sem trabalho. Para isso, ele combina grandes volumes de memória de alta velocidade com armazenamento integrado ao próprio chip, o que garante que os dados necessários aos modelos estejam sempre acessíveis sem depender constantemente de sistemas externos.

Em termos de arquitetura, ele também recebeu melhorias no desempenho computacional, incorporando mais unidades de processamento por servidor e utilizando CPUs baseadas em designs personalizados da arquitetura ARM.

Outro destaque é a adaptação para modelos modernos de inteligência artificial, especialmente aqueles que utilizam a abordagem de mistura de especialistas (MoE), na qual diferentes partes do modelo são ativadas conforme a necessidade. Para suportar esse tipo de carga, o TPU 8i reforça significativamente a comunicação entre chips, diminuindo gargalos e tornando o fluxo de dados mais rápido.

Wagner Edwards

Wagner Edwards é Bacharel em Jornalismo e atua como Analista de SEO e de Conteúdo no Olhar Digital. Possui experiência, também, na redação, edição e produção de textos para notícias e reportagens.